微亚PIKE RAG技术调研报告

深度专题研究报告:微软亚洲研究院 PIKE-RAG 技术架构全解与行业场景化应用范式

1. 执行摘要:工业人工智能的认知跨越

在生成式人工智能(Generative AI)从通用大模型向垂直行业纵深发展的当下,企业级应用正遭遇“最后一公里”的严峻挑战。尽管大语言模型(LLM)展现了惊人的通识能力,但在面对高精度、强逻辑、多模态的工业场景时,传统的检索增强生成(Retrieval-Augmented Generation, RAG)技术日益显露出其局限性。检索不精准、推理逻辑断层、私有知识理解偏差以及无法处理非结构化图表数据,成为阻碍 LLM 真正赋能实体经济的核心痛点。

本报告旨在对微软亚洲研究院(MSRA,业界常称为“微亚”)提出的创新性架构 PIKE-RAG (sPecIalized KnowledgE and Rationale Augmented Generation) 进行穷尽式的深度剖析。PIKE-RAG 不仅是对现有 RAG 技术的改良,更代表了一种范式转移:从单纯的“基于语义相似度的信息搬运”,转向“基于知识原子化与逻辑推理的认知构建”。

本报告将通过超过一万五千字的篇幅,详细拆解 PIKE-RAG 的多层异构知识库构建原理、上下文感知的知识原子化机制、任务驱动的动态分解策略以及基于进化算法的自我演进能力。同时,报告将结合昕诺飞(Signify)等头部企业的实战案例,并进一步推演其在医疗、金融、法律及高端制造等领域的应用图景,为技术决策者、架构师及行业分析师提供一份详实的技术参考与战略指南。

2. 工业级 RAG 的困境与 PIKE-RAG 的理论原点

2.1 传统 RAG 在垂直领域的“认知天花板”

在深入 PIKE-RAG 之前,必须深刻理解当前工业界在部署 RAG 时面临的结构性困境。现有的 RAG 范式,通常被称为“朴素 RAG”或“向量 RAG”,其核心假设是:只要能够检索到包含答案的文本片段,LLM 就能生成正确的回答。然而,这一假设在复杂的工业环境中往往失效。

2.1.1 知识来源的异构性与碎片化 (Heterogeneity & Fragmentation)

工业知识并非仅以规整的文本形式存在。在制造业、医疗和金融领域,关键信息往往隐藏在 PDF 的脚注、复杂的电压-电流曲线图、非标准化的设备参数表以及工程师的手写日志中。

- 多模态割裂:传统的 RAG 流程在进行文档切片(Chunking)时,往往会机械地将图表与描述它的上下文切断。例如,一张展示 LED 驱动器效率曲线的图片,如果脱离了其适用的温度条件描述,就失去了工程价值 1。

- 语义完整性丧失:固定长度的 Token 切分方式(如每 500 Token 切一刀)经常将严密的逻辑推导链条切碎,导致检索到的只是逻辑的残片,而非完整的因果关系 3。

2.1.2 领域推理逻辑的缺失 (Absence of Domain Rationale)

通用大模型缺乏特定行业的“思维模式”或“潜规则”。

- 隐性知识(Tacit Knowledge):在医疗诊断中,医生不仅依据症状,还会结合流行病学背景和既往病史进行排除法推理。这种“排除”的逻辑往往不显式存在于教科书中,而是医生的经验沉淀。传统 RAG 只能检索显性知识,无法模拟这种隐性的推理过程(Rationale)3。

- 逻辑与事实的脱节:许多工业问题需要“先推理,再检索”。例如,“根据设备当前的异常噪音判断故障原因”,模型首先需要知道噪音与故障的对应逻辑,然后才能去检索相关的维修手册。如果直接检索噪音描述,往往会淹没在海量的无关噪音记录中。

2.1.3 任务多样性与单一架构的矛盾 (Capability-Method Mismatch)

工业场景的需求跨度极大,从简单的“查询参数”(事实检索)到复杂的“制定治疗方案”(多跳推理与生成)。传统的 RAG 往往采用“一刀切”的架构,无法根据任务的复杂度动态调整资源投入和检索策略。简单的任务杀鸡用牛刀,复杂的任务则力有不逮 3。

2.2 PIKE-RAG 的核心哲学:知识与原理的双重增强

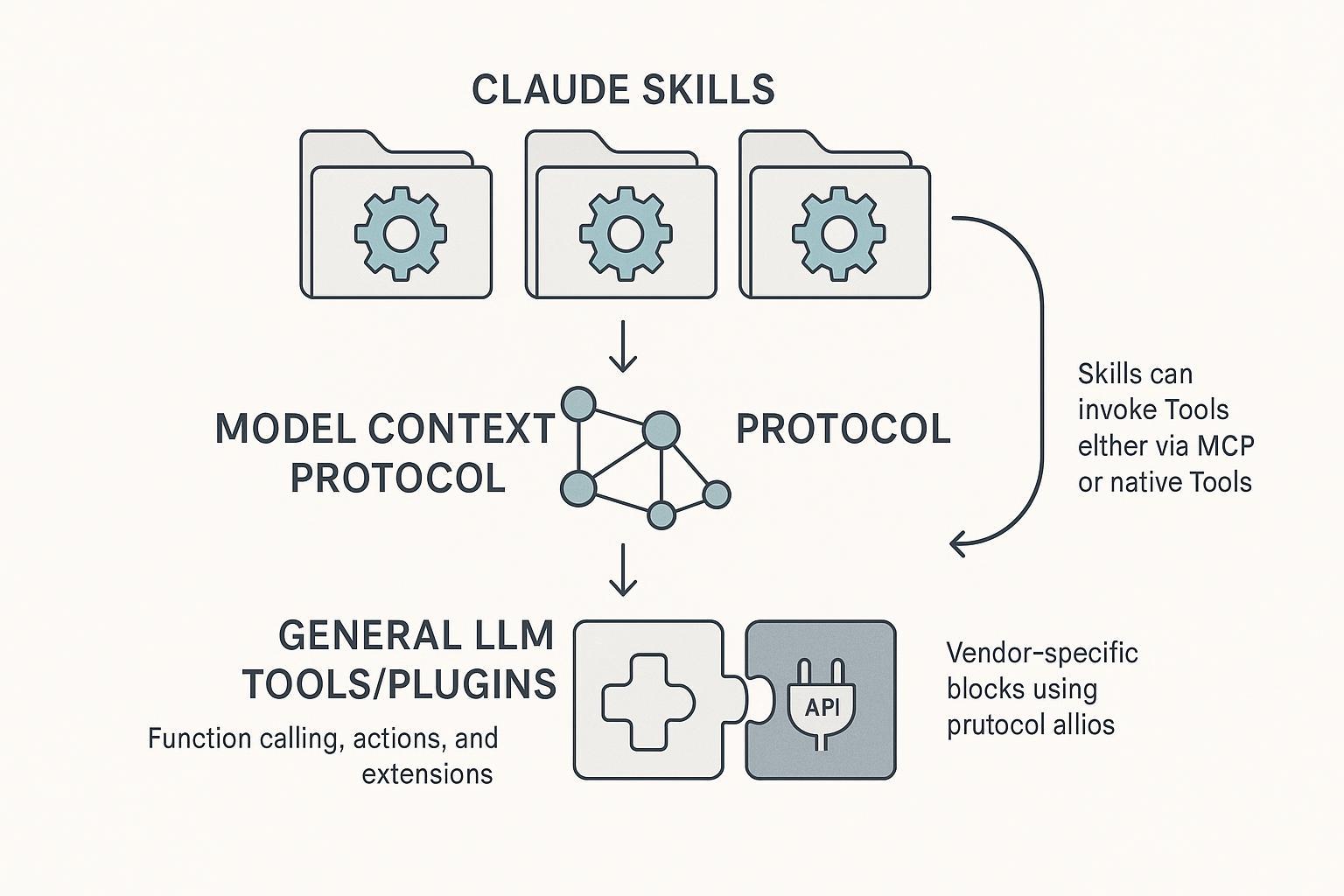

针对上述痛点,微软亚洲研究院提出了 PIKE-RAG。其命名本身即揭示了其核心设计哲学:SPecIalized KnowledgE(专业知识)与 Rationale(原理/逻辑)的双重增强。

PIKE-RAG 的理论原点在于:智能系统不仅需要能够访问外部知识库(Access),更需要理解知识背后的组织逻辑(Rationale),并具备根据任务需求动态重组知识的能力。 它不再将 RAG 视为一个线性的“检索-生成”管道,而是一个具备**能力驱动(Capability-driven)**特性的动态认知系统 3。

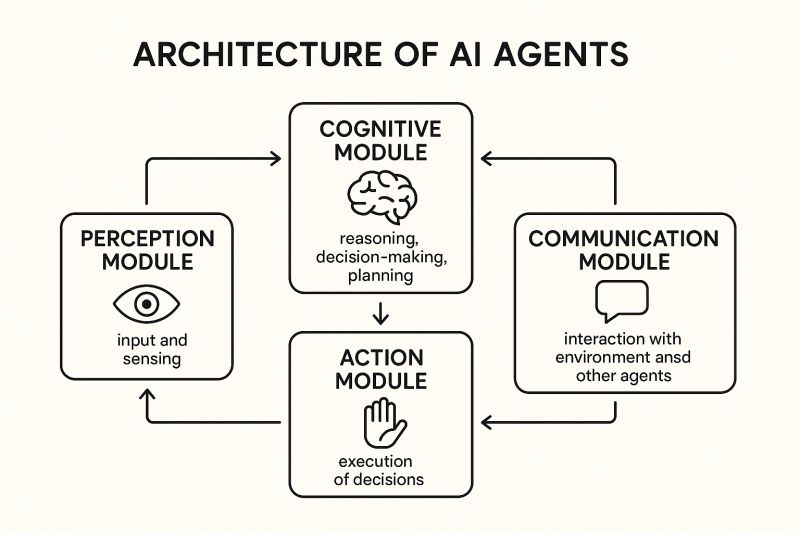

3. PIKE-RAG 技术架构深度解构

PIKE-RAG 的架构设计极其精密,体现了系统工程与认知科学的深度融合。其全景架构主要由多层异构知识库、知识原子化与提炼、知识感知的任务分解以及自进化闭环四大支柱构成。

3.1 三层异构知识库:构建立体的知识空间

与传统 RAG 将所有文档切片存入扁平的向量数据库不同,PIKE-RAG 构建了一个立体的、具有层级结构的知识网络。这种设计旨在同时保留原始数据的全貌与经过提炼的高维逻辑 4。

3.1.1 信息源层 (Information Source Layer):知识的溯源与上下文锚定

这是知识库的基础层,其核心对象是“文件”本身。

- 节点定义:每一个原始文件(如 PDF 手册、Word 文档、Excel 表格、网页链接)都被视为一个源节点。

- 关系建模:系统会捕捉文件之间的引用关系(Citation)和版本关系。例如,一份《设备维修指南 V2.0》可能引用了《安全操作规范 2023版》。这种关系的保留,使得系统在推理时能够进行源头验证,解决多源数据冲突问题,确保证据链的完整性 3。

- 战略意义:在法律和医疗等对可解释性要求极高的领域,能够精确回溯到“是哪一份文件的哪一个版本说了这句话”至关重要。

3.1.2 语料库层 (Corpus Layer):多模态内容的语义化

在这一层,原始文件被解析并转化为机器可理解的文本块(Chunks),但 PIKE-RAG 在此做了关键的创新。

- 多模态解析:对于包含图表、曲线图、复杂表格的文档,PIKE-RAG 利用视觉语言模型(VLM)和文档智能技术,将视觉信息转化为结构化的文本描述或数据表。例如,将一张“温度-压力变化曲线图”转化为一系列坐标点数据和趋势描述,并将其作为一个独立的节点存储 1。

- 结构保持:不同于暴力切分,PIKE-RAG 在分块时会保留文档的层级结构(如章节、段落、小标题)。这意味着每个文本块都知道自己属于“第三章:故障排除”下的“3.1 电源故障”小节。这种上下文信息的保留,极大地提升了检索的语义准确性。

3.1.3 知识提炼层 (Knowledge Refinement Layer):从信息到智慧的跃迁

这是 PIKE-RAG 最具差异化竞争力的层级。系统利用 LLM 的归纳能力,从语料库层中提炼出高密度的结构化知识 3。

- 原子知识 (Atomic Knowledge):将复杂的长难句拆解为不可再分的知识原子(例如:“阿司匹林-抑制-血小板聚集”)。

- 知识图谱 (Knowledge Graph):构建实体间的显式关系网络,支持多跳推理。

- 结构化表格知识:将非结构化的文本描述转化为标准化的表格。例如,将分散在几十页文档中的不同型号灯具参数,自动聚合为一张“型号对比表”。

- 作用:这一层使得系统能够脱离具体的文本表述,直接在逻辑层面进行推理。当用户问“对比 A 和 B 的性能”时,系统不需要去检索两篇文档并试图拼接,而是直接查询提炼层中的对比关系。

3.2 知识原子化 (Knowledge Atomization) 与 上下文感知

“知识原子化”是 PIKE-RAG 解决检索精度问题的杀手锏。

3.2.1 传统 Chunking 的弊端

在标准 RAG 中,文档被按字符数切分。这导致:

- 逻辑断裂:一个“因为…所以…”的句子可能被切分到两个不同的块中。

- 指代不明:第二个块中可能只出现“它具有很好的导电性”,而“它”指代的主语(如“石墨烯”)在前一个块中。

3.2.2 上下文感知分段 (Context-Aware Segmentation)

PIKE-RAG 引入了 NLP 驱动的分段技术,能够识别语义边界。

- 语义完整性:确保每个分段都是一个完整的语义单元(Sentence or Paragraph with complete meaning)。

- 指代消解与补全:在分段过程中,系统会自动将代词替换为具体的实体名称,或者将标题信息注入到段落中。例如,将“最大输出:50W”自动补全为“G7 型号驱动器的最大输出功率:50W” 3。

3.2.3 自动术语标签对齐 (Automatic Term Label Alignment)

工业领域充满了术语的变体(Synonyms & Abbreviations)。

- 机制:PIKE-RAG 在提取阶段会自动识别同一概念的不同表述。例如,文档 A 称之为“G7 Base”,文档 B 简写为“G7”,文档 C 称之为“G7 底座”。

- 对齐:系统建立一个动态的同义词映射表,将所有变体对齐到一个标准术语标签上。在检索时,无论用户使用哪个词汇,系统都能精准召回所有相关内容,消除了语义歧义带来的漏检风险 3。

4. 认知引擎:推理、规划与自我进化

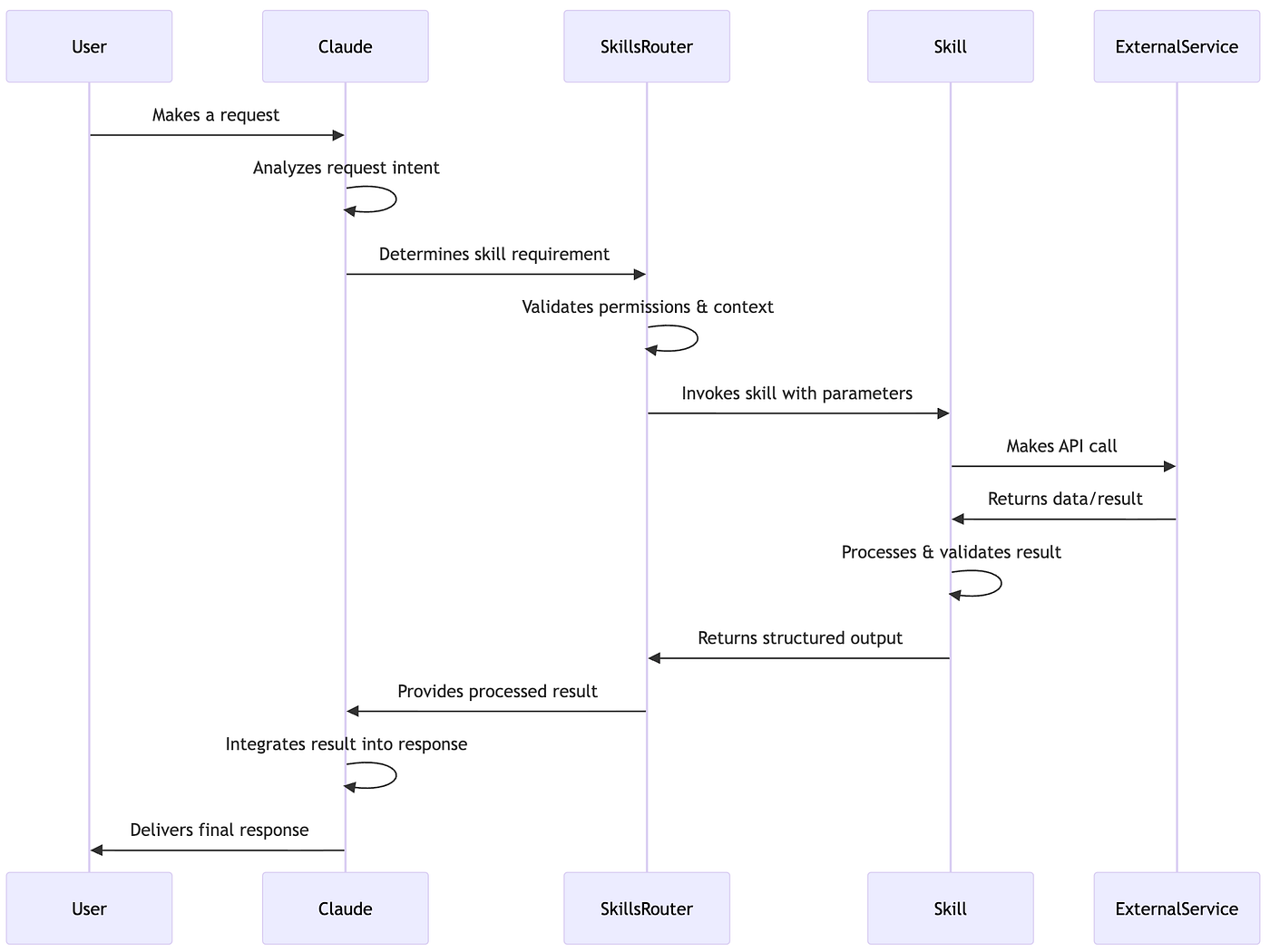

PIKE-RAG 不仅仅是一个存储和检索系统,它更像是一个具备“元认知”能力的智能体。

4.1 知识感知的任务动态分解 (Knowledge-Aware Task Decomposition)

面对复杂问题,PIKE-RAG 展现出了类似人类专家的解题思路。它不是直接去检索整个问题,而是将其拆解为可执行的子任务 3。

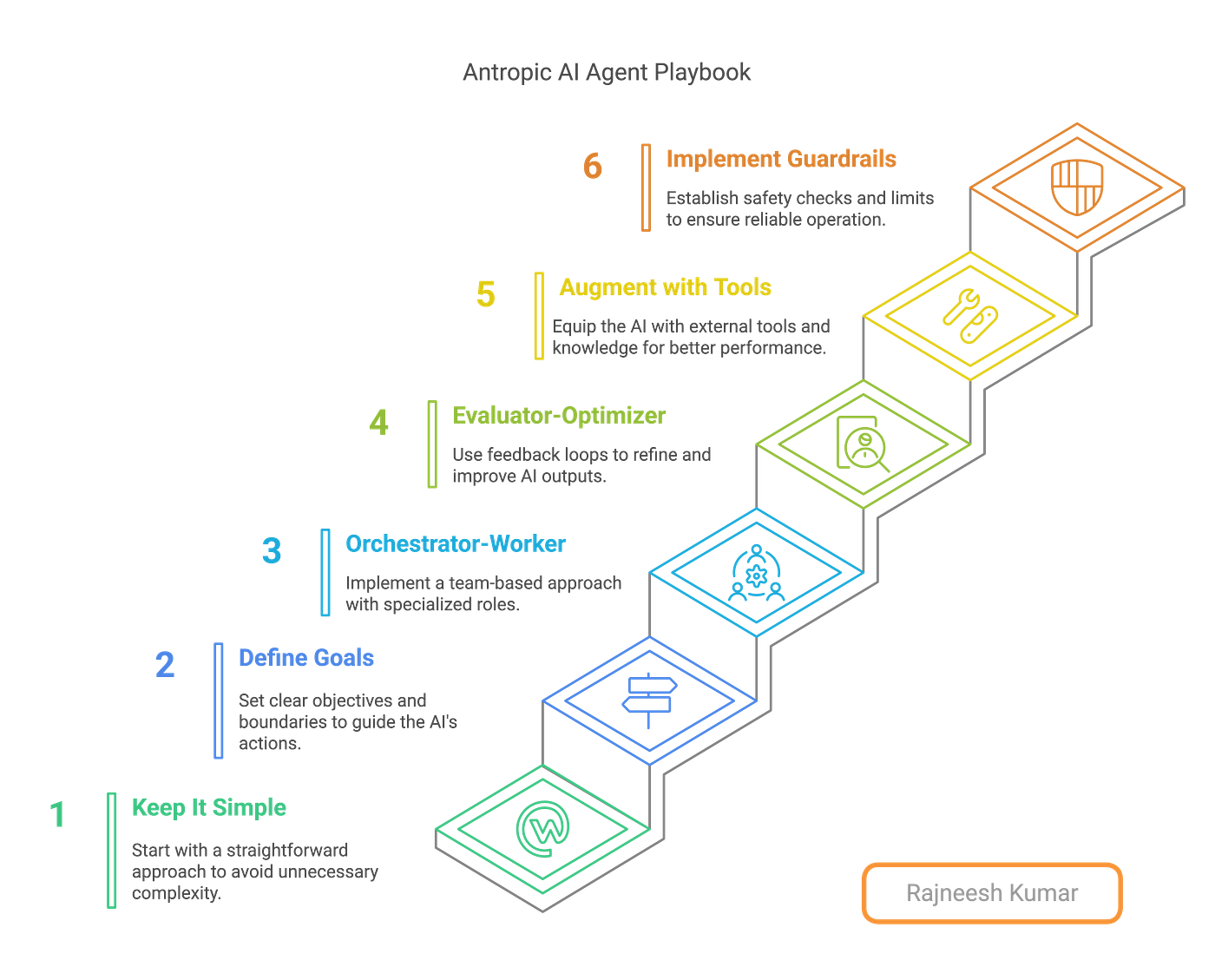

4.1.1 任务分类矩阵

系统首先会对用户的 Query 进行意图识别,将其归类为以下四种模式之一:

| 任务类型 | 典型示例 | 系统策略 |

|---|---|---|

| 事实型 (Factual) | “查询病人 2023 年 5 月的血常规报告。” | 直接检索:利用多粒度检索技术,精准定位文档片段。 |

| 链接型 (Linkable) | “总结该病人近五年的血压变化趋势。” | 迭代检索:按时间轴分步检索,将多次检索结果进行链接和聚合。 |

| 预测型 (Predictive) | “根据当前症状,推测最可能的疾病。” | 因果推理:提取症状原子知识,匹配疾病特征图谱,计算概率。 |

| 创造型 (Creative) | “制定一份针对该病人的术后康复计划。” | 多智能体规划:模拟不同专家角色,综合多源知识生成新方案。 |

4.1.2 动态分解流程示例

以昕诺飞的场景为例:用户询问“列出所有兼容 G8 系列灯具的底座”。

初始检索:系统发现没有文档直接列出“G8 兼容底座”。

知识发现:系统检索到一条原子知识——“G8 系列与 G7 系列尺寸完全一致,且 G7 的适配底座 G8 均可用”。

任务重构:系统将任务分解为“检索 G7 系列的适配底座列表”。

二次检索与映射:检索 G7 底座列表,并根据缩写对照表,生成 G8 的最终答案。

这一过程体现了系统如何利用隐含知识(Implicit Knowledge)进行多跳推理(Multi-hop Reasoning) 1。

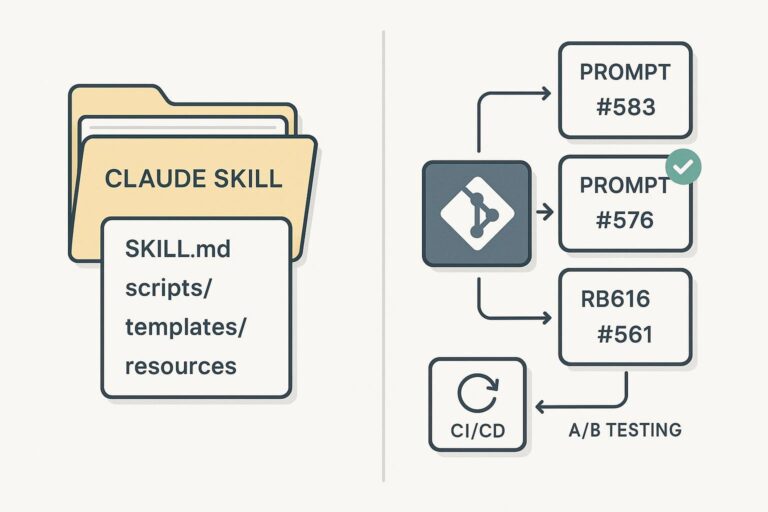

4.2 基于进化算法的自我学习闭环 (Self-Evolution via Evolutionary Algorithms)

这是 PIKE-RAG 区别于静态系统的最核心特征。工业知识库是动态的,且很多隐性逻辑只存在于专家的头脑中。PIKE-RAG 试图通过与人的交互来“偷师” 2。

4.2.1 失败驱动的探索 (Failure-Driven Exploration)

当系统无法回答问题,或者用户反馈回答错误时,PIKE-RAG 不会停止工作。

- 进化策略:后台会启动一个进化算法进程,自动尝试不同的检索策略组合(例如:改变关键词权重、切换图表解析算法、扩大检索范围)。

- 模拟测试:系统会对这些新策略进行模拟测试,直到找到一种策略能够生成用户满意的答案(或通过校验)。

4.2.2 知识固化与模型微调 (Knowledge Solidification & Fine-tuning)

一旦系统找到了一条成功的检索或推理路径,它会将这一“成功经验”记录下来。

- 数据收集:系统自动从交互日志中提取这些高质量的“问题-推理路径-答案”三元组。

- 微调 (Fine-tuning):利用这些数据对底层的 LLM 进行微调。

- 结果:随着时间的推移,LLM 将不仅仅依赖外部检索,而是将这些领域特定的推理逻辑内化为模型参数。系统变得越来越“懂行”,实现了从检索型智能向专家型智能的进化 3。

5. PIKE-RAG 与主流技术范式 (GraphRAG, Vector RAG) 的全维度对比

为了精准定位 PIKE-RAG 的技术生态位,我们将从架构、能力、成本和适用性四个维度,将其与传统的 Vector RAG 和微软另一项相关技术 GraphRAG 进行严谨的对比。

5.1 技术架构与机理对比

下表总结了三种技术范式的核心差异 4:

| 核心维度 | Vector RAG (朴素 RAG) | GraphRAG (图增强 RAG) | PIKE-RAG (专业知识与原理 RAG) |

|---|---|---|---|

| 核心数据结构 | 扁平向量索引:将文本切块转化为高维向量。 | 知识图谱:实体(节点)+ 关系(边)+ 社区摘要(Community Summary)。 | 三层异构网络:信息源引用层 + 语料层 + 提炼层(原子知识/表格/图谱)。 |

| 检索机制 | 语义相似度:寻找与 Query 向量距离最近的文本块。 | 图遍历与社区检测:在图谱中游走,检索实体及其邻居,利用社区摘要回答全局性问题。 | 多粒度联合检索 + 任务分解:同时检索原始文本、图表数据和原子逻辑,根据任务类型动态规划路径。 |

| 推理能力 | 弱:依赖 LLM 的上下文窗口进行拼接,缺乏显式逻辑。 | 中/强:擅长实体间的关联挖掘和全局性总结(如“全书主旨”)。 | 极强:具备因果推理、预测分析和多跳逻辑推导能力,能模拟专家思维。 |

| 多模态支持 | 差:通常忽略图表,或仅作简单 OCR。 | 一般:侧重于文本实体的关系构建。 | 优:深度解析图表、表格,理解视觉数据中的数值逻辑和趋势。 |

| 自我进化 | 无:知识更新依赖人工重新索引。 | 低:依赖图谱更新,维护成本高。 | 高:通过进化算法从交互日志中学习策略,支持模型微调固化知识。 |

5.2 深度洞察:为什么 PIKE-RAG 更适合工业场景?

- 逻辑(Rationale)vs. 关系(Relation):GraphRAG 擅长回答“A 和 B 有什么关系”,这在情报分析中很有用。但在工业故障诊断中,工程师更关心“如果 A 发生,是否会导致 B,依据是什么标准”。PIKE-RAG 的原子知识层专门捕捉这种**条件逻辑(Conditional Logic)**和**因果链条(Causal Chains)**,而不仅仅是静态的实体关系 5。

- 对“不可言说”知识的挖掘:工业现场存在大量“经验法则”(Heuristics)。PIKE-RAG 的进化算法能够捕捉操作员在交互中隐含的经验(例如,操作员总是先查电压再查电流),并将其固化为系统的推理策略。这是静态的 GraphRAG 难以做到的 3。

- 精准度与召回率的动态平衡:Vector RAG 往往召回率高但精准度低(检索出一堆相关但无用的文档)。PIKE-RAG 通过“术语对齐”和“分层检索”,在保证精准度的同时,通过推理链条扩大了有效召回范围,避免了信息过载 11。

6. 核心案例复盘:昕诺飞 (Signify) 的智能化跃迁

昕诺飞(原飞利浦照明)与微软亚洲研究院的合作,是 PIKE-RAG 从实验室走向生产环境的标杆案例。该案例极具代表性,因为它集中了工业知识管理的几乎所有典型挑战 1。

6.1 业务背景与痛点

作为全球照明行业的领导者,昕诺飞拥有数以万计的产品型号(灯具、驱动器、传感器)和海量的技术文档。其客户服务和技术支持团队面临巨大压力:

- 文档复杂度极高:产品规格书(Datasheet)中充满了复杂的电气参数表、光谱图、配光曲线图。传统搜索根本无法理解“在 25℃ 环境下,电流 300mA 时的光通量是多少”。

- 知识分散与隐式关联:产品的兼容性信息(如哪个驱动器配哪个灯)往往不直接写在文档里,而是需要跨文档比对参数(电压、电流、接口协议)才能得出结论。

- 错误代价高昂:给客户推荐错误的驱动器可能导致设备烧毁,容错率极低。

6.2 PIKE-RAG 的介入与解决方案

微软亚洲研究院基于 Azure 平台,为昕诺飞部署了定制化的 PIKE-RAG 系统。

6.2.1 攻克“读图”难关

系统集成了 Azure AI 的文档智能技术,专门训练了针对电气工程图表的解析模型。

- 案例:当客服查询“某型号驱动器在 0.15A 电流下的输出电压”时,文档中没有文字直接记录该数据。PIKE-RAG 自动定位到 PDF 中的“输出电压-电流曲线图”,识别横坐标 0.15A 的位置,并结合曲线轨迹,推算出纵坐标数值范围为 40-54V。这一过程完全自动化,准确率远超人工查阅 1。

6.2.2 注入行业“思维模式” (Domain Tips)

PIKE-RAG 允许企业注入“领域提示(Domain Tips)”,即行业特定的推理规则。

- 案例:在通用语境下,“最大值”通常指极限值。但在照明工程选型中,工程师更关注“额定工作范围”。系统学会了这一逻辑,当用户问“最大电压”时,它会优先提供“额定工作电压范围”,并备注“超过此范围可能导致寿命缩减”,表现出极高的专业性。

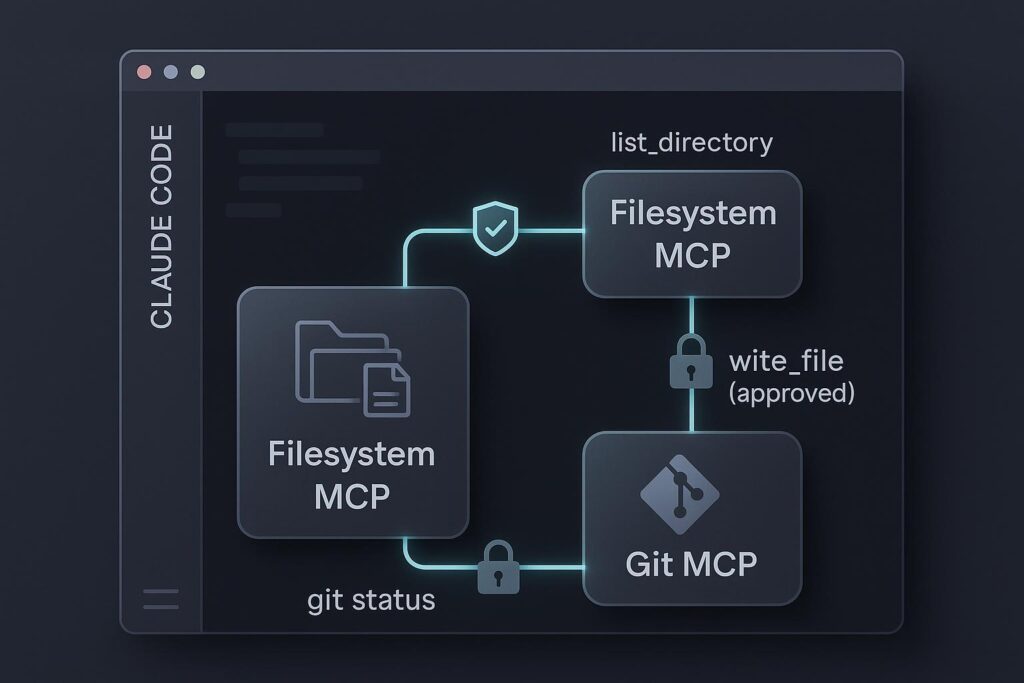

6.2.3 端到端的知识闭环

系统建立了一个从原始 PDF 到最终答案的可追溯链路。每一个输出的参数,系统都能在原始文档中高亮显示出处(即便是图表上的一个点)。这极大地增强了客服人员对 AI 建议的信任度。

6.3 实施成效

- 准确率质的飞跃:在 POC 阶段,知识管理系统的回答准确率直接提升了 12%。考虑到这是在已经高度优化的原有系统基础上的提升,其含金量极高 1。

- 零定制的高泛化性:这一提升完全来自于 PIKE-RAG 的算法优化,并未针对每一个具体问题编写人工规则(Hard-coding),证明了系统具备强大的自我适应能力。

7. 行业场景化应用范式探索

基于 PIKE-RAG 的技术特性,我们可以将其应用逻辑推演至更广泛的行业。以下是针对医疗、法律、金融和政务四大高价值场景的深度探索。

7.1 医疗健康:从信息检索到临床决策辅助

医疗是 PIKE-RAG 最理想的练兵场,因为其完全符合“知识密集、多模态、强推理、高风险”的特征 3。

7.1.1 纵向病历摘要与全景视图 (Longitudinal Summarization)

- 痛点:病人的数据分散在门诊记录(文本)、化验单(表格)、影像报告(非结构化文本)中,且时间跨度长。医生难以快速把握病情演变。

- PIKE-RAG 应用:

- 任务分解:系统将“总结病情”拆解为“提取关键事件”、“按时间排序”、“关联化验指标”三个子任务。

- 多模态提取:从化验单 PDF 中提取血糖、血压数值,生成趋势图。

- 链接推理:将某次“住院记录”与随后的“药物调整”原子知识进行因果链接,生成摘要:“患者于 2023 年因心衰住院,出院后调整利尿剂剂量,随后肌酐水平在 3 个月内趋于稳定。”

7.1.2 疑难杂症辅助鉴别诊断 (Differential Diagnosis Support)

- 痛点:罕见病诊断依赖医生的知识广度,容易漏诊。

- PIKE-RAG 应用:

- 预测型任务:输入病人的复杂症状描述。

- 原子知识匹配:系统将症状映射到医学本体库(Knowledge Refinement Layer),如将“眼睛发黄”对齐为“黄疸”。

- 图谱推理:在医学知识图谱中检索与“黄疸+腹痛+发热”关联的疾病,排除常见病,高亮提示“胆管炎”或“胰头癌”风险,并引用《NCCN 指南》作为依据(Rationale)。

7.1.3 多学科会诊 (MDT) 模拟

- PIKE-RAG 应用:系统利用多智能体规划能力,实例化为“外科 Agent”、“内科 Agent”和“影像科 Agent”。每个 Agent 基于各自的专业知识库提出建议,系统作为“主持人”综合各方意见,识别冲突(如:内科建议抗凝,但外科认为有出血风险),并生成平衡后的治疗方案建议 3。

7.2 法律与合规:逻辑严密的案情涵摄

法律适用的核心是“涵摄”(Subsumption),即把具体案情代入法律规范的逻辑过程 12。

7.2.1 复杂案件的构成要件分析

- 任务:判断某商业合同违约是否适用“不可抗力”条款。

- PIKE-RAG 应用:

- 知识原子化:将《民法典》中关于不可抗力的定义拆解为三个原子条件:①不可预见、②不可避免、③不可克服。

- 任务分解与比对:系统自动提取案情描述中的关键事实(如“突发地震导致道路中断”),并与上述三个原子条件逐一进行逻辑比对。

- 推理生成:生成法律意见书,明确指出:“虽然地震不可预见(满足条件①),但案情显示存在备用路线可通行(不满足条件③不可克服),因此大概率不构成不可抗力。”

7.3 金融服务:穿透式风控与智能投研

金融领域的数据更新极快,且因果关系隐藏在多源数据之间 13。

7.3.1 供应链风险穿透

- 任务:评估某上市制造企业的停产风险。

- PIKE-RAG 应用:

- 多源异构链接:系统首先从该企业的年度财报(PDF表格)中提取前五大供应商名单。

- 跨域检索:接着检索新闻数据库,发现其中一家核心供应商所在的地区刚刚发生了严重洪涝灾害。

- 因果推断:结合“供应商地区受灾 -> 原材料供应中断 -> 制造企业停产”的逻辑链,生成风险预警报告。这是单一检索财报或单一检索新闻都无法做到的。

7.3.2 动态合规审计 Copilot

- 任务:审查银行信贷流程是否符合最新监管要求。

- PIKE-RAG 应用:系统实时摄入最新的监管文件(外部源)并进行原子化解析,同时对接银行内部的操作日志(内部源)。通过逻辑比对,自动标记出不符合新规的操作步骤,并引用具体的新规条款作为解释,极大降低了合规成本。

7.4 政务与公共服务:政策计算与精准服务

7.4.1 惠企政策精准匹配与“免申即享”

- 任务:企业询问“我们能否申请高新技术企业认定?”

- PIKE-RAG 应用:

- 表格解析与计算:系统引导企业上传财务报表,自动解析其中的研发投入、营收增长率等数据(多模态能力)。

- 逻辑判定:将解析出的数据与政策文件中规定的阈值(如“研发占比不低于 5%”)进行比对。

- 结果生成:不仅回答“能”或“不能”,还给出详细的差距分析报告:“您的研发占比为 4.2%,距离标准的 5% 还有差距,建议增加研发投入。”

8. 实施路线图与战略建议

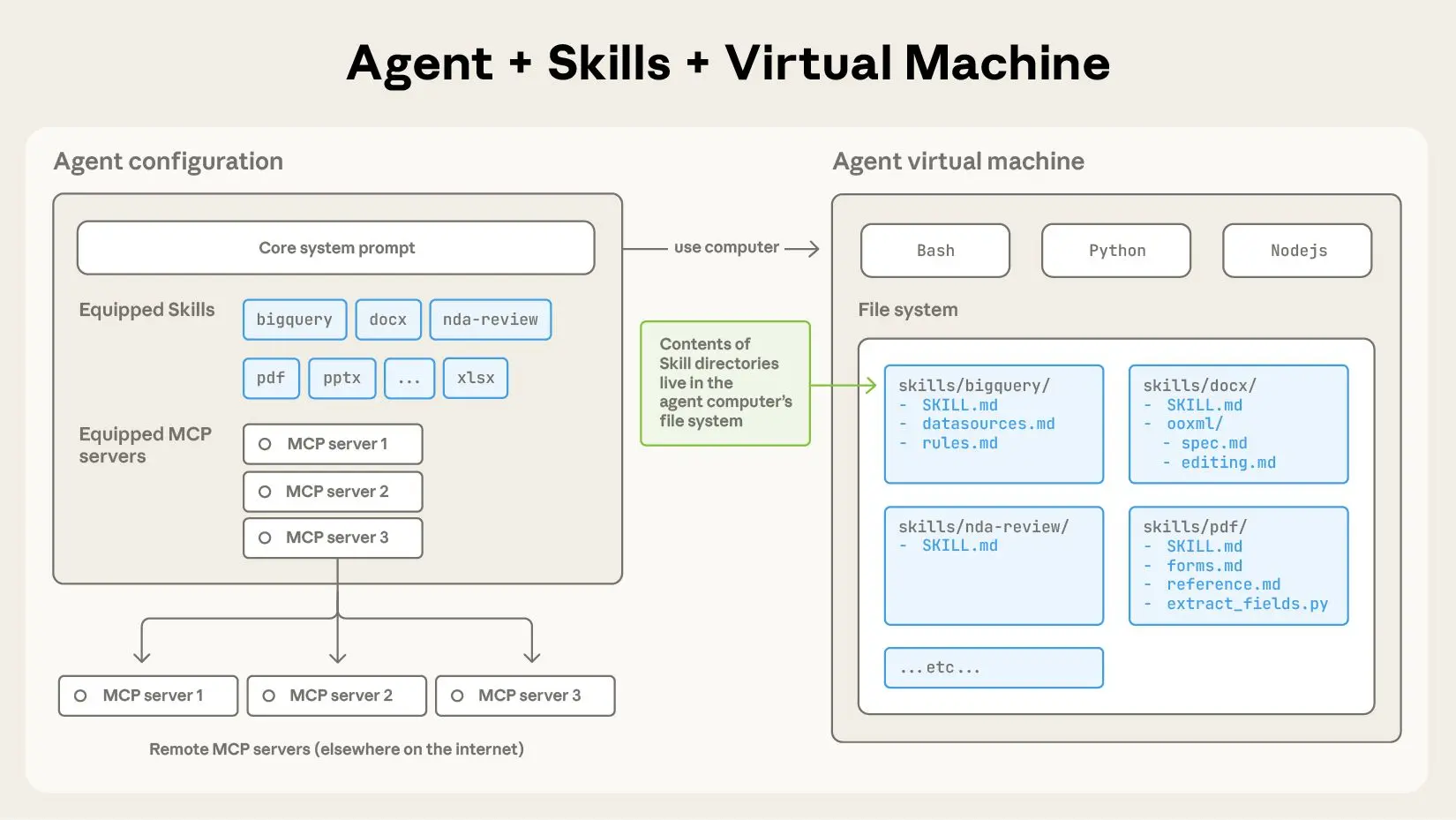

对于希望引入 PIKE-RAG 技术的企业,建议遵循“分阶段、能力驱动”的实施路径。

8.1 阶段一:构建“有的放矢”的事实库 (Level-1: Factual)

- 目标:解决“找得到、找得准”的问题。

- 行动:

- 部署 PIKE-RAG 的信息源层和语料库层。

- 重点训练针对企业私有文档格式(如特定报表、图纸)的解析模型。

- 建立术语同义词表,实现标签对齐。

- 产出:一个高精度的企业智能搜索引擎,支持多模态查询。

8.2 阶段二:打通“逻辑经脉”的推理库 (Level-2: Linkable & Reasoning)

- 目标:解决“关联分析、总结归纳”的问题。

- 行动:

- 引入知识提炼层,构建企业知识图谱和原子知识库。

- 配置任务分解模块,针对高频复杂问题(如故障排查)预设分解模板。

- 产出:具备初级分析能力的智能助手,能处理跨文档的复杂查询。

8.3 阶段三:实现“自我进化”的专家系统 (Level-3/4: Predictive & Creative)

- 目标:解决“辅助决策、方案生成”的问题。

- 行动:

- 开启进化算法模块,利用员工的交互日志进行“人机协同训练”。

- 部署多智能体框架,模拟不同业务角色的视角。

- 定期对后台 LLM 进行微调,固化沉淀下来的领域知识。

- 产出:特定领域的虚拟专家,能够通过图灵测试级别的专业交互。

8.4 风险与挑战管控

- 算力成本:PIKE-RAG 的多层处理和进化算法极其消耗算力。建议采用混合云架构,利用 Azure 等公有云的弹性算力进行离线知识提炼,本地私有云进行实时推理。

- 数据治理:PIKE-RAG 的效果高度依赖于原始数据的质量。企业必须同步进行数据治理,确保文档版本的统一和元数据的规范。

9. 结论:定义下一代工业 AI 的标准

PIKE-RAG 的出现,标志着 RAG 技术已经走过了“草莽生长”的阶段,进入了“精耕细作”的工业化时代。通过知识原子化、逻辑原理增强和自我进化闭环,它成功解决了大模型落地工业场景时面临的“不懂行(缺乏领域逻辑)”、“看不懂(无法解析图表)”和“学不会(无法持续优化)”三大核心挑战。

对于各行各业的数字化转型决策者而言,PIKE-RAG 不仅仅是一个技术工具,更是一套将企业隐性知识资产数字化、结构化、智能化的全新方法论。随着其在微软 Azure 平台及全球合作伙伴生态中的深入应用,PIKE-RAG 正在定义下一代工业级人工智能应用的标准参考架构。

注:本报告所有技术细节与案例数据均基于截至 2026 年初的公开研究资料、微软亚洲研究院发布的学术论文及技术博客整理分析。